一文读懂 NVIDIA GTC 2026:从大模型到 Agent 的七个关键词

大家好,我是若风。

今年 3 月 16 号,NVIDIA 在美国圣何塞举办了 GTC 2026 大会,这是整个 AI 行业一年一度的“风向标”式活动。黄仁勋用一场信息量巨大的演讲,勾勒出了从大模型走向“AI 助手(Agent)”和“AI 工厂”的未来图景。

如果要用几个关键词,把这次大会讲清楚,我会选这七个:Token、DLSS 5、Vera Rubin、Agentic AI、OpenClaw、Physical AI 和 AI 工厂。下面我们用尽量不“吓人”的方式,把它们讲给所有对 AI 感兴趣的朋友听。

Token:AI 世界的新“原子”

过去我们聊 AI,总是从“参数”“算力”“大模型”这些词开始,听起来离普通人有点远。这次 GTC,黄仁勋用了一个更接地气的切入口: Token 。

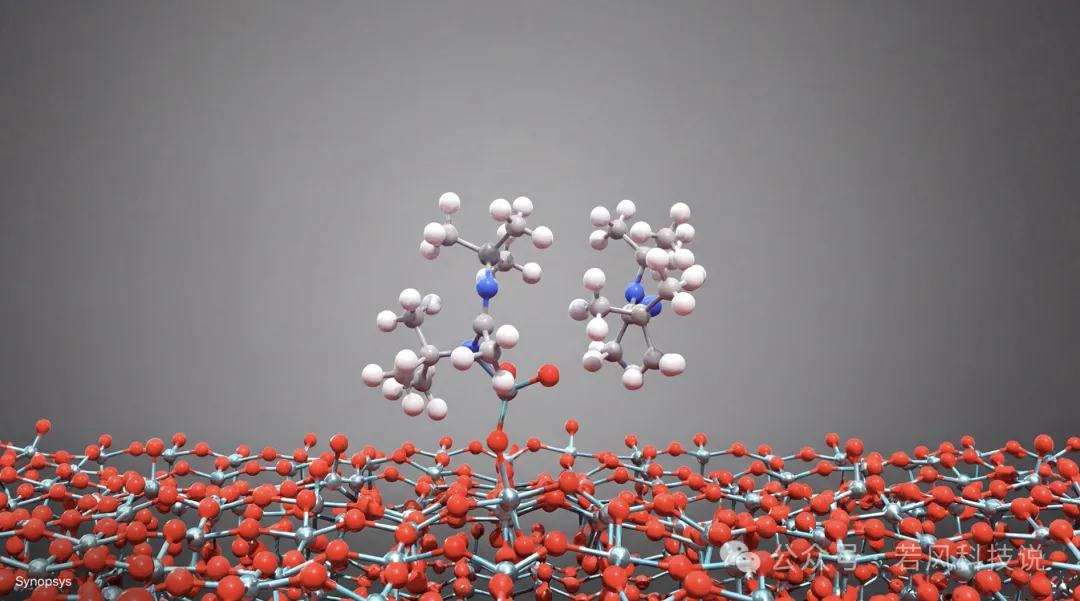

可以把 Token 理解成 AI 世界里的“字”和“拼音”。模型不会直接理解一个完整的句子,而是先把它拆成一个个 Token。图像、代码、甚至机器人控制指令,也可以被编码成 Token。模型的工作,其实就是不断“预测下一个 Token 是什么”。

为什么这个视角重要?因为在 Token 眼里,文本、图片、视频、控制命令,通通被统一成同一种“信息货币”。这让 AI 有可能在同一个大脑里,同时理解我们说的话、屏幕上的画面,以及现实世界中的动作和反馈。

这也解释了 NVIDIA 在大会上频频提到的一个底层能力:过去 20 年围绕 CUDA 打造的加速计算平台。简单说, Token 越多、模型越大、推理越频繁,就越需要强大的加速芯片和软件栈来“烧算力” 。

DLSS 5:AI 接管游戏画面

说完“看不见”的 Token,我们来聊一个大家一眼能看懂的东西:游戏画面。

NVIDIA 这次发布的 DLSS 5 ,是面向游戏玩家和实时图形的一次升级。传统的游戏画面生成,是靠显卡一步步把每个像素算出来,再呈现到屏幕上;而 DLSS 的思路是,先用较低的分辨率、较轻的负担算出一个“粗略画面”,再交给深度学习模型来“脑补细节”,输出接近甚至超过原生分辨率的画面。结果就是:画面更细腻,帧数更高,硬件压力反而更小。

DLSS 5 在此基础上又往前走了一步,引入了更多 3D 场景信息作为“引导”,让 AI 更好理解画面结构,更聪明地预测运动模糊、反射、阴影等细节,让画面看起来更自然。

对普通玩家来说,感受就是“同样的电脑,画面更好、游戏更流畅”;对整个行业来说,这意味着一件事: AI 不再只是“算模型”的工具,而是开始主动接管传统的图形、视频等计算任务 。未来我们看到的很多画面,可能都有 AI 悄悄参与创作。

Vera Rubin:面向未来的“AI 大机房”

聊完前端体验,我们把镜头拉到后台,看看支撑这一切的“基建”。

黄仁勋在 GTC 2026 上重点介绍了一个新的全栈平台: Vera Rubin 。乍一听像是某款新显卡,实际上它是一整套为 AI 打造的“大机房解决方案”。底层有专门为 AI 设计的 CPU 和 GPU,中间有高速互联芯片和网络交换设备,把成千上万块芯片连成一个整体,上面是机架级的整机系统,部署在数据中心里,成为企业自己的“AI 工厂大脑”。

为什么要搞这么复杂?原因很现实:大模型越来越大、推理请求越来越多,单机根本扛不住;企业不再只是做一次模型训练,而是要 7×24 小时为业务提供 AI 服务;这背后需要的是“系统工程”:算力、网络、存储、散热、运维,一起设计。

Vera Rubin 做的,就是把这套复杂的“拼装工程”封装成标准化的平台,让云厂商、大企业可以更快搭建自己的 AI 基础设施。对于我们这些终端用户来说,感知可能只有一句话: 各种 AI 服务的响应会更快、更稳定、更便宜 。

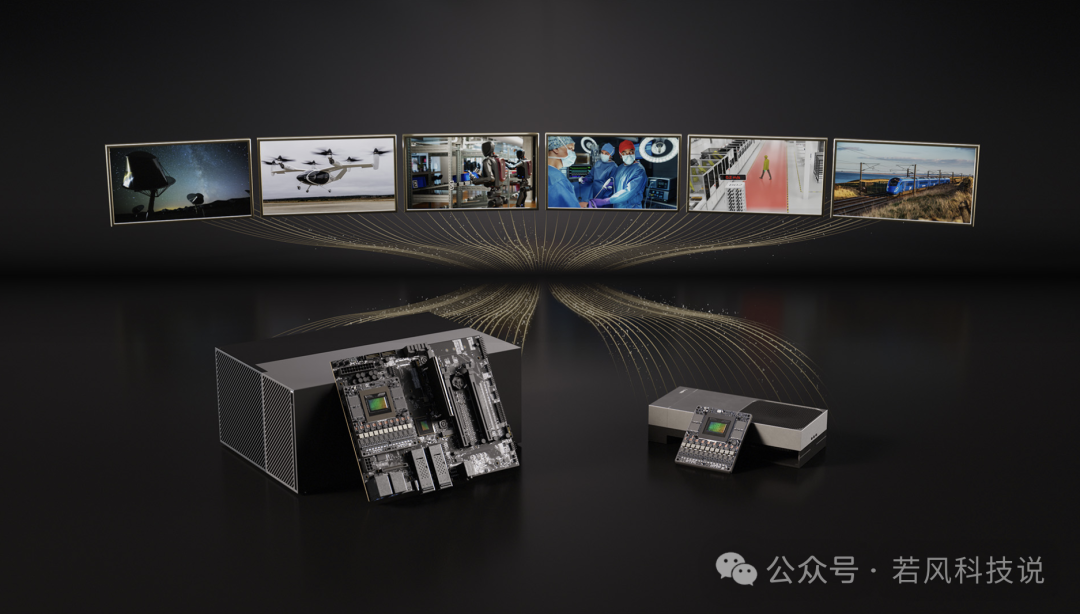

Agentic AI:AI 不只会聊天,还要会“干活”

过去一年,大家被各种“对话式 AI”刷屏:写作文、写代码、画图、做 PPT……但它们大多还是 “一问一答”的短期互动 。

GTC 2026 之后,一个被反复提到的词是: Agentic AI(代理式 AI) 。这个词可以简单理解为不是你每问一句,它才回一句,而是你给它一个目标,让它自己想办法搞定。中间可能要查资料、调用工具、写脚本、发邮件、跑流程,AI 会自己规划步骤。

举一个日常一点的例子。过去你对 AI 说:“帮我写一篇 1000 字的团建总结”;未来你可能会说:“帮我组织一次 30 人的团建,预算 2 万,地点在广州,记得最后给我一份总结。”中间的定路线、订场地、做行程、做表格、收反馈、出总结,都会由一组 AI 代理协同完成,人只在关键环节确认和决策。

要让这件事成真,需要的不只是“聪明的模型”,还需要能安全访问公司内部数据,能和各种软件系统对接(日历、邮件、审批、报销……),能把复杂任务拆解成一系列可执行的小步骤。

这也是为什么,NVIDIA 在大会上强调的是“从大模型到 Agentic AI”的过渡: 真正的价值,不在于 AI 说得多精彩,而在于它能帮你做成多少事情。

OpenClaw:为 Agent 准备的“操作系统”

如果把 Agent 看作“AI 小助手”,那它们也需要一个“操作系统”来管理。

在 GTC 2026 上,NVIDIA 提出了一个新平台: OpenClaw 。可以把它想象成面向 AI 助手的基础平台,负责工具调用、任务编排、权限控制等;对开发者来说,相当于一套搭建 AI 助手应用的“积木盒子”;对企业来说,是连接模型、数据和业务系统的一座“中间桥梁”。

为什么要做成开源、标准化?不同公司有各自的业务系统,如果每家都“从头自建”,成本高、风格乱、安全难统一;有一个通用的、被广泛采用的“Agent 操作系统”,可以让生态更容易协同:工具可以复用、经验可以迁移、治理可以统一。

你可以把它类比为当年的 Linux。Linux 让不同厂商可以在统一内核上打造自己的操作系统;OpenClaw 则希望让不同公司在统一底座上,搭建自己的 AI 代理系统。

这对终端用户意味着什么?简单说: 未来你用到的很多“AI 功能”,可能看起来五花八门,但在背后,很多都是在类似的底层平台上运行。统一的底层,会让整体体验更连贯、更稳定,也更安全。

Physical AI:AI 走出屏幕,走向现实

这次 GTC 最抓人眼球的一幕,是一个很多人都认识的角色——《冰雪奇缘》里的雪宝(Olaf)机器人登上舞台。

这个“雪宝”并不是简单的遥控玩具,而是借助 3D 仿真和数字孪生技术,在虚拟环境中反复训练、调试,使用 AI 模型让它的表情、动作、互动都更自然,最终在现实世界中,以机器人形态和人面对面交流。

这背后对应的概念叫 Physical AI(物理 AI) :AI 不再只停留在手机、电脑屏幕上,而是“住进”各种物理设备中,从自动驾驶汽车,到仓库里的搬运机器人,再到家里的智能设备,AI 会越来越多地直接影响现实世界的动作。

对于我们普通人来说,这意味着“无人驾驶”“无人仓库”“无人巡检“会从概念变成常态,景区、商场、展馆里出现会说话、能指路、会互动的机器人会变得越来越普遍,家里的智能硬件也会从”听指令“进化到”能判断、会帮忙”。

当 AI 真的“长出手脚”以后,我们讨论的就不再只是“回答是否准确”,还会多出安全、伦理、责任等全新话题。这也是物理 AI 时代必须严肃面对的议题。

AI 工厂:算力,变成新的“水电煤”

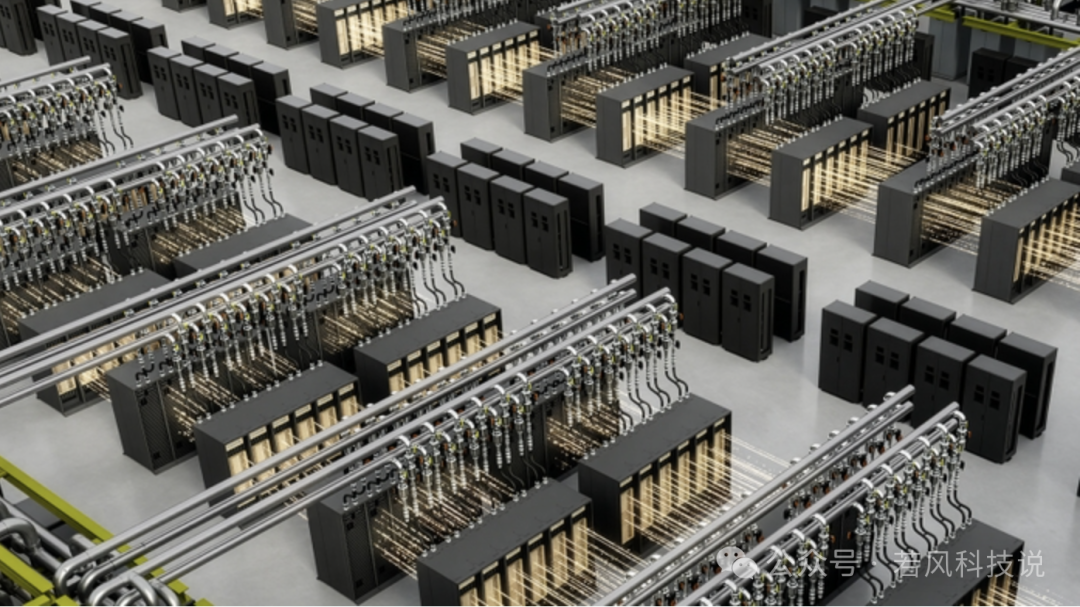

最后一个关键词,是这次大会最“基础设施”的部分: AI 工厂 。

过去,我们习惯把数据中心看成“放服务器的机房”。而在 GTC 2026 的叙事里,它被直接比作工业时代的发电厂。发电厂把能源转化成电,供给整个城市;AI 工厂把芯片、能源、冷却等组合在一起,产出源源不断的“算力”和“智能服务”。

黄仁勋反复强调,未来几年在 AI 工厂上的投入,可能会达到万亿美金的规模。这背后的逻辑是:每一家互联网公司、制造企业、金融机构,都会越来越依赖 AI 做决策、做推荐、做运营;越多业务依赖 AI,越需要稳定、可扩展、成本可控的算力基础设施;长远看,算力会像水电一样,成为一个国家、一个行业的“基础供应”。

对我们来说,可以这样理解:未来很多产品的体验差异,不只是“谁的界面更好看”,而是“谁背后连着更强、更聪明的 AI 工厂”;对企业来说,如何选择、构建、利用好这些 AI 工厂,会逐渐变成核心竞争力的一部分。

写在最后:从“看热闹”,到“用起来”

把这七个关键词串起来,你大概能看到 GTC 2026 想讲的一件事:

「底层」 ,用 Vera Rubin 和 AI 工厂撑起更强大的算力基础;

「中层」 ,用大模型 + Agentic AI + OpenClaw,把“会聊天的模型”升级为“会做事的助手”;

「前端」 ,用 DLSS 5 和 Physical AI,让 AI 既能在屏幕里提升体验,也能走进现实世界。

对于普通人和大多数企业来说,一个现实的建议是:不必急着追每一个新缩写、新芯片,先搞清楚 AI 能帮你做什么;从身边的小任务、小流程开始实验,让 AI 真正参与进来;在这个过程中,逐步思考我们的数据怎么整理、权限怎么管理、风险怎么控制。

GTC 2026 给行业画了一张未来 AI 的“施工图”,而每一个个体和组织,最终都要回答同一个问题: 在这张图里,我准备好自己的位置了吗?

评论互动